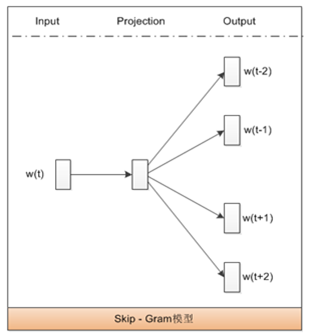

见图片,Skip-Gram模型是Word2Vec模型的一种,属于词嵌入模型,故AD错误。C选项说的是Word2Vec模型的另一种CBOW模型。

正确答案是:B: 模型的目标是最大化用当前的词预测上下文的词的生成概率。

专业分析:

Skip-Gram模型是一种用于训练词向量的模型,它的目标是通过给定的中心词(当前词)来预测它的上下文词。具体来说,Skip-Gram模型在训练过程中会尝试最大化给定一个词的情况下,预测它周围词的概率。这与选项B的描述一致。

选项A和D是错误的,因为Skip-Gram模型不属于词袋模型(Bag-of-Words)或词集模型(Set-of-Words)。词袋模型是通过统计词频来表示文本,而词集模型则是通过集合的方式来表示词汇关系。

选项C也是错误的,因为它描述的是CBOW(Continuous Bag of Words)模型的目标。CBOW模型的目标是通过上下文词来预测中心词,这与Skip-Gram模型的目标不同。

因此,正确答案是B。